100 р бонус за первый заказ

Выберите тип работы Дипломная работа Курсовая работа Реферат Магистерская диссертация Отчёт по практике Статья Доклад Рецензия Контрольная работа Монография Решение задач Бизнес-план Ответы на вопросы Творческая работа Эссе Чертёж Сочинения Перевод Презентации Набор текста Другое Повышение уникальности текста Кандидатская диссертация Лабораторная работа Помощь on-line

Узнать цену

После того как найдено уравнение линейной регрессии, проводится оценка значимости как уравнения в целом, так и отдельных его параметров . Проверить значимость уравнения регрессии – значит установить, соответствует ли математическая модель, выражающая зависимость между переменными, экспериментальным данным и достаточно ли включенных в уравнение объясняющих переменных (одной или нескольких) для описания зависимой переменной. Чтобы иметь общее суждение о качестве модели из относительных отклонений по каждому наблюдению, определяют среднюю ошибку аппроксимации : Средняя ошибка аппроксимации не должна превышать 8–10%.

Оценка значимости уравнения регрессии в целом производится на основе F

-критерия Фишера

, которому предшествует дисперсионный анализ. Согласно основной идее дисперсионного анализа, общая сумма квадратов отклонений переменной y

от среднего значения y

раскладывается на две части – «объясненную» и «необъясненную»: где – общая сумма квадратов отклонений; – сумма квадратов отклонений, объясненная регрессией (или факторная сумма квадратов отклонений); ![]() – остаточная сумма квадратов отклонений, характеризующая влияние неучтенных в модели факторов. Определение дисперсии на одну степень свободы приводит дисперсии к сравнимому виду. Сопоставляя факторную и остаточную дисперсии в расчете на одну степень свободы, получим величину F

-критерия Фишера:

– остаточная сумма квадратов отклонений, характеризующая влияние неучтенных в модели факторов. Определение дисперсии на одну степень свободы приводит дисперсии к сравнимому виду. Сопоставляя факторную и остаточную дисперсии в расчете на одну степень свободы, получим величину F

-критерия Фишера:  Фактическое значение F

-критерия Фишера сравнивается с

Фактическое значение F

-критерия Фишера сравнивается с

табличным значением F табл(a; k 1; k 2) при уровне значимости a и степенях свободы k 1 = m и k 2= n -m -1.При этом, если фактическое значение F - критерия больше табличного, то признается статистическая значимость уравнения в целом.

Для парной линейной регрессии m

=1, поэтому

Величина F

-критерия связана с коэффициентом детерминации R2 ее можно рассчитать по следующей формуле:

В парной линейной регрессии оценивается значимость не только уравнения в целом, но и отдельных его параметров

. С этой целью по каждому из параметров определяется его стандартная ошибка: m b

и m a

. Стандартная ошибка коэффициента регрессии определяется по формуле: , где

, где

Величина стандартной ошибки совместно с t –распределением Стьюдента при n -2 степенях свободы применяется для проверки существенности коэффициента регрессии и для расчета его доверительного интервала. Для оценки существенности коэффициента регрессии его величина сравнивается с его стандартной ошибкой, т.е. определяется фактическое значение t -критерия Стьюдента: которое затем сравнивается с табличным значением при определенном уровне значимости a и числе степеней свободы (n-2). Доверительный интервал для коэффициента регрессии определяется как b ± t табл ×mb . Поскольку знак коэффициента регрессии указывает на рост результативного признака y при увеличении признака-фактора x (b >0), уменьшение результативного признака при увеличении признака-фактора (b <0) или его независимость от независимой переменной (b =0), то границы доверительного интервала для коэффициента регрессии не должны содержать противоречивых результатов, например, -1,5 £ b £ 0,8. Такого рода запись указывает, что истинное значение коэффициента регрессии одновременно содержит положительные и отрицательные величины и даже ноль, чего не может быть.

Стандартная ошибка параметра a

определяется по формуле:  Процедура оценивания существенности данного параметра не отличается от рассмотренной выше для коэффициента регрессии. Вычисляется t

-критерий: , его величина сравнивается с табличным значением при n

- 2 степенях свободы.

Процедура оценивания существенности данного параметра не отличается от рассмотренной выше для коэффициента регрессии. Вычисляется t

-критерий: , его величина сравнивается с табличным значением при n

- 2 степенях свободы.

Оценив параметры a

и b

, мы получили уравнение регрессии, по которому можно оценить значения y

по заданным значениям x

. Естественно полагать, что расчетные значения зависимой переменной не будут совпадать с действительными значениями, так как линия регрессии описывает взаимосвязь лишь в среднем, в общем. Отдельные значения рассеяны вокруг нее. Таким образом, надежность получаемых по уравнению регрессии расчетных значений во многом определяется рассеянием наблюдаемых значений вокруг линии регрессии. На практике, как правило, дисперсия ошибок неизвестна и оценивается по наблюдениям одновременно с параметрами регрессии a

и b

. Вполне логично предположить, что оценка связана с суммой квадратов остатков регрессии. Величина является выборочной оценкой дисперсии возмущений , содержащихся в теоретической модели ![]() . Можно показать, что для модели парной регрессии

. Можно показать, что для модели парной регрессии

где - отклонение фактического значения зависимой переменной от ее расчетного значения.

Если ![]() , то для всех наблюдений фактические значения зависимой переменной совпадают с расчетными (теоретическими) значениями.

Графически это означает, что теоретическая линия регрессии (линия, построенная по функции ) проходит через все точки корреляционного поля, что возможно только при строго функциональной связи. Следовательно, результативный признак у

полностью обусловлен влиянием фактора х.

, то для всех наблюдений фактические значения зависимой переменной совпадают с расчетными (теоретическими) значениями.

Графически это означает, что теоретическая линия регрессии (линия, построенная по функции ) проходит через все точки корреляционного поля, что возможно только при строго функциональной связи. Следовательно, результативный признак у

полностью обусловлен влиянием фактора х.

Обычно на практике имеет место некоторое рассеивание точек корреляционного поля относительно теоретической линии регрессии, т. е. отклонения эмпирических данных от теоретических . Этот разброс обусловлен как влиянием фактора х , т.е. регрессией y по х , (такую дисперсию называют объясненной, так как она объясняется уравнением регрессии),так и действием прочих причин (необъясненная вариация, случайная). Величина этих отклонений и лежит в основе расчета показателей качества уравнения.

Согласно основному положению дисперсионного анализа общая сумма квадратов отклонений зависимой переменной y от среднего значения может быть разложена на две составляющие: объясненную уравнением регрессии и необъясненную:

,

,

где - значения y , вычисленные по уравнению .

Найдем отношение суммы квадратов отклонений, объясненной уравнением регрессии, к общей сумме квадратов:

, откуда

, откуда

. (7.6)

. (7.6)

Отношение части дисперсии, объясненной уравнением регрессии к общей дисперсии результативного признака называется коэффициентом детерминации . Значение не может превзойти единицы и это максимальное значение будет только достигнуто при , т.е. когда каждое отклонение равно нулю и поэтому все точки диаграммы рассеяния в точности лежат на прямой.

Коэффициент детерминации характеризует долю объясненной регрессией дисперсии в общей величине дисперсии зависимой переменной. Соответственно величина характеризует долю вариации (дисперсии) у, необъясненную уравнением регрессии, а значит, вызванную влиянием прочих неучтенных в модели факторов. Чем ближе к единице, тем выше качество модели.

При парной линейной регрессии коэффициент детерминации равен квадрату парного линейного коэффициента корреляции: .

Корень из этого коэффициента детерминации есть коэффициент (индекс) множественной корреляции, или теоретическое корреляционное отношение.

Для того чтобы узнать, действительно ли полученное при оценке регрессии значение коэффициента детерминации отражает истинную зависимость между y и x выполняют проверку значимости построенного уравнения в целом и отдельных параметров. Проверка значимости уравнения регрессии позволяет узнать, пригодно уравнение регрессии для практического использования, например, для прогноза или нет.

При этом выдвигают основную гипотезу о незначимости уравнения в целом, которая формально сводится к гипотезе о равенстве нулю параметров регрессии, или, что то же самое, о равенстве нулю коэффициента детерминации: . Альтернативная гипотеза о значимости уравнения - гипотеза о неравенстве нулю параметров регрессии или о неравенстве нулю коэффициента детерминации: .

Для проверки значимости модели регрессии используют F- критерий Фишера, вычисляемый как отношение суммы квадратов (в расчете на одну независимую переменную) к остаточной сумме квадратов (в расчете на одну степень свободы):

, (7.7)

, (7.7)

где k – число независимых переменных.

После деления числителя и знаменателя соотношения (7.7) на общую сумму квадратов отклонений зависимой переменной, F- критерий может быть эквивалентно выражен на основе коэффициента :

.

.

Если нулевая гипотеза справедлива, то объясненная уравнением регрессии и необъясненная (остаточная) дисперсии не отличаются друг от друга.

Расчетное значение F- критерий сравнивается с критическим значением, которое зависит от числа независимых переменных k , и от числа степеней свободы (n-k-1) . Табличное (критическое) значение F- критерия – это максимальная величина отношений дисперсий, которое может иметь место при случайном расхождении их для заданного уровня вероятности наличия нулевой гипотезы. Если расчетное значение F- критерий больше табличного при заданном уровне значимости, то нулевая гипотеза об отсутствии связи отклоняется и делается вывод о существенности этой связи, т.е. модель считается значимой.

Для модели парной регрессии

.

.

В линейной регрессии обычно оценивается значимость не только уравнения в целом, но и отдельных его коэффициентов. Для этого определяется стандартная ошибка каждого из параметров. Стандартные ошибки коэффициентов регрессии параметров определяются по формулам:

, (7.8)

, (7.8)

(7.9)

(7.9)

Стандартные ошибки коэффициентов регрессии или среднеквадратические отклонения, рассчитанные по формулам (7.8,7.9), как правило, приводятся в результатах расчета модели регрессии в статистических пакетах.

Опираясь на среднеквадратические ошибки коэффициентов регрессии, проверяют значимость этих коэффициентов используя обычную схему проверки статистических гипотез.

В качестве основной гипотезы выдвигают гипотезу о незначимом отличии от нуля «истинного» коэффициента регрессии. Альтернативной гипотезой при этом является гипотеза обратная, т. е. о неравенстве нулю «истинного» параметра регрессии. Проверка этой гипотезы осуществляется с помощью t- статистики, имеющей t -распределение Стьюдента:

Затем расчетные значения t- статистики сравниваются с критическими значениями t- статистики, определяемыми по таблицам распределения Стьюдента. Критическое значение определяется в зависимости от уровня значимости α и числа степеней свободы, которое равно (n-k-1), п - число наблюдений, k - число независимых переменных. В случае линейной парной регрессии число степеней свободы равно (п- 2). Критическое значение также может быть вычислено на компьютере с помощью встроенной функции СТЬЮДРАСПОБР пакета Ехсеl.

Если расчетное значение t- статистики больше критического, то основную гипотезу отвергают и считают, что с вероятностью (1-α) «истинный» коэффициент регрессии значимо отличается от нуля, что является статистическим подтверждением существования линейной зависимости соответствующих переменных.

Если расчетное значение t- статистики меньше критического, то нет оснований отвергать основную гипотезу, т. е. «истинный» коэффициент регрессии незначимо отличается от нуля при уровне значимости α . В этом случае фактор, соответствующий этому коэффициенту должен быть исключен из модели.

Значимость коэффициента регрессии можно установить методом построения доверительного интервала. Доверительный интервал для параметров регрессии a и b определяют следующим образом:

![]() ,

,

![]() ,

,

где определяется по таблице распределения Стьюдента для уровня значимости α и числа степеней свободы (п- 2) для парной регрессии.

Поскольку коэффициенты регрессии в эконометрических исследованиях имеют четкую экономическую интерпретацию, доверительные интервалы не должны содержать нуль. Истинное значение коэффициента регрессии не может одновременно содержать положительные и отрицательные величины, в том числе и нуль, иначе мы получаем противоречивые результаты при экономической интерпретации коэффициентов, чего не может быть. Таким образом, коэффициент значим, если полученный доверительный интервал не накрывает нуль.

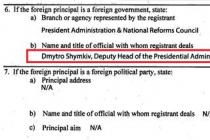

Пример 7.4. По данным примера 7.1:

а) Построить парную линейную модель регрессии зависимости прибыли от реализации от отпускной цены с использованием программных средств обработки данных.

б) Оценить значимость уравнения регрессии в целом, используя F- критерий Фишера при α=0,05.

в) Оценить значимость коэффициентов модели регрессии, используя t -критерий Стьюдента при α=0,05 и α=0,1.

Для проведения регрессионного анализа используем стандартную офисную программу EXCEL. Построение регрессионной модели проведем с помощью инструмента РЕГРЕССИЯ настройки ПАКЕТ АНАЛИЗА (рис.7.5), запуск которого осуществляется следующим образом:

СервисАнализ данныхРЕГРЕССИЯОК.

Рис.7.5. Использование инструмента РЕГРЕССИЯ

В диалоговом окне РЕГРЕССИЯ в поле Входной интервал Y необходимо ввести адрес диапазона ячеек, содержащих зависимую переменную. В поле Входной интервал Х нужно ввести адреса одного или нескольких диапазонов, содержащих значения независимых переменных Флажок Метки в первой строке – устанавливается в активное состояние, если выделены и заголовки столбцов. На рис. 7.6. показана экранная форма вычисления модели регрессии с помощью инструмента РЕГРЕССИЯ.

Рис. 7.6. Построение модели парной регрессии с помощью

инструмента РЕГРЕССИЯ

В результате работы инструмента РЕГРЕСИЯ формируется следующий протокол регрессионного анализа (рис.7.7).

Рис. 7.7. Протокол регрессионного анализа

Уравнение зависимости прибыли от реализации от отпускной цены имеет вид:

Оценку значимости уравнения регрессии проведем используя F-

критерий Фишера. Значение F-

критерий Фишера возьмем из таблицы «Дисперсионный анализ» протокола EXCEL (рис. 7.7.). Расчетное значение F-

критерия 53,372. Табличное значение F-

критерия при уровне значимости α=0,05

и числе степеней свободы ![]() составляет 4,964. Так как

составляет 4,964. Так как ![]() , то уравнение считается значимым.

, то уравнение считается значимым.

Расчетные значения t -критерия Стьюдента для коэффициентов уравнения регрессии приведены в результативной таблице (рис. 7.7). Табличное значение t -критерия Стьюдента при уровне значимости α=0,05 и 10 степенях свободы составляет 2,228. Для коэффициента регрессии a , следовательно коэффициент a не значим. Для коэффициента регрессии b , следовательно, коэффициент b значим.

После оценки индивидуальной статистической значимости каждого из коэффициентов регрессии обычно анализируется совокупная значимость коэффициентов, т.е. всего уравнения в целом. Такой анализ осуществляется на основе проверки гипотезы об общей значимости гипотезы об одновременном равенстве нулю всех коэффициентов регрессии при объясняющих переменных:

H 0: b 1 = b 2 = ... = b m = 0.

Если данная гипотеза не отклоняется, то делается вывод о том, что совокупное влияние всех m объясняющих переменных Х 1 , Х 2 , ..., Х m модели на зависимую переменную Y можно считать статистически несущественным, а общее качество уравнения регрессии – невысоким.

Проверка данной гипотезы осуществляется на основе дисперсионного анализа сравнения объясненной и остаточной дисперсии.

Н 0: (объясненная дисперсия) = (остаточная дисперсия),

H 1: (объясненная дисперсия) > (остаточная дисперсия).

Строится F-статистика:

где ![]() – объясненная регрессией дисперсия;

– объясненная регрессией дисперсия;

– остаточная дисперсия (сумма квадратов отклонений, поделённая на число степеней свободы n-m-1). При выполнении предпосылок МНК построенная F-статистика имеет распределение Фишера с числами степеней свободы n1 = m, n2 = n–m–1. Поэтому, если при требуемом уровне значимости a F набл > F a ; m ; n - m -1 = F a (где F a ; m ; n - m -1 - критическая точка распределения Фишера), то Н 0 отклоняется в пользу Н 1 . Это означает, что объяснённая регрессией дисперсия существенно больше остаточной дисперсии, а следовательно, уравнение регрессии достаточно качественно отражает динамику изменения зависимой переменной Y. Если F набл < F a ; m ; n - m -1 = F кр. , то нет основания для отклонения Н 0 . Значит, объясненная дисперсия соизмерима с дисперсией, вызванной случайными факторами. Это дает основание считать, что совокупное влияние объясняющих переменных модели несущественно, а следовательно, общее качество модели невысоко.

Однако на практике чаще вместо указанной гипотезы проверяют тесно связанную с ней гипотезу о статистической значимости коэффициента детерминации R 2:

Н 0: R 2 > 0.

Для проверки данной гипотезы используется следующая F-статистика:

![]() . (8.20)

. (8.20)

Величина F при выполнении предпосылок МНК и при справедливости H 0 имеет распределение Фишера, аналогичное распределению F-статистики (8.19). Действительно, разделив числитель и знаменатель дроби в (8.19) на общую сумму квадратов отклонений ![]() и зная, что она распадается на сумму квадратов отклонений, объяснённую регрессией, и остаточную сумму квадратов отклонений (это является следствием, как будет показано позже, системы нормальных уравнений)

и зная, что она распадается на сумму квадратов отклонений, объяснённую регрессией, и остаточную сумму квадратов отклонений (это является следствием, как будет показано позже, системы нормальных уравнений)

![]() ,

,

мы получим формулу (8.20):

Из (8.20) очевидно, что показатели F и R 2 равны или не равны нулю одновременно. Если F = 0, то R 2 = 0, и линия регрессии Y = является наилучшей по МНК, и, следовательно, величина Y линейно не зависит от Х 1 , Х 2 , ..., Х m . Для проверки нулевой гипотезы Н 0: F = 0 при заданном уровне значимости a по таблицам критических точек распределения Фишера находится критическое значение F кр = F a ; m ; n - m -1 . Нулевая гипотеза отклоняется, если F > F кр. Это равносильно тому, что R 2 > 0, т.е. R 2 статистически значим.

Анализ статистики F позволяет сделать вывод о том, что для принятия гипотезы об одновременном равенстве нулю всех коэффициентов линейной регрессии коэффициент детерминации R 2 не должен существенно отличаться от нуля. Его критическое значение уменьшается при росте числа наблюдений и может стать сколь угодно малым.

Пусть, например, при оценке регрессии с двумя объясняющими переменными X 1 i , X 2 i по 30 наблюдениям R 2 = 0,65. Тогда

F набл = =25,07.

По таблицам критических точек распределения Фишера найдем F 0,05; 2; 27 = 3,36; F 0,01; 2; 27 = 5,49. Поскольку F набл = 25,07 > F кр как при 5%–м, так и при 1%–м уровне значимости, то нулевая гипотеза в обоих случаях отклоняется.

Если в той же ситуации R 2 = 0,4, то

F набл = = 9.

Предположение о незначимости связи отвергается и здесь.

Отметим, что в случае парной регрессии проверка нулевой гипотезы для F-статистики равносильна проверке нулевой гипотезы для t-статистики

коэффициента корреляции. В этом случае F-статистика равна квадрату t-статистики. Самостоятельную значимость коэффициент R 2 приобретает в случае множественной линейной регрессии.

8.6. Дисперсионный анализ для разложения общей суммы квадратов отклонений. Степени свободы для соответствующих сумм квадратов отклонений

Применим изложенную выше теорию для парной линейной регрессии.

После того, как найдено уравнение линейной регрессии, проводится оценка значимости как уравнения в целом, так и отдельных его параметров.

Оценка значимости уравнения регрессии в целом даётся с помощью F-критерия Фишера. При этом выдвигается нулевая гипотеза, что коэффициент регрессии равен нулю, т.е. b = 0, и, следовательно, фактор х не оказывает влияния на результат у.

Непосредственному расчёту F-критерия предшествует анализ дисперсии. Центральное место в нём занимает разложение общей суммы квадратов отклонений переменной у от среднего значения на две части – “объяснённую” и “необъяснённую”:

Уравнение (8.21) является следствием системы нормальных уравнений, выведенных в одной предыдущих тем.

Доказательство выражения (8.21).

![]()

![]()

Осталось доказать, что последнее слагаемое равно нулю.

Если сложить от 1 до n все уравнения

y i = a+b×x i +e i , (8.22)

то получим åy i = a×å1+b×åx i +åe i . Так как åe i =0 и å1 =n, то получим

Тогда ![]() .

.

Если же вычесть из выражения (8.22) уравнение (8.23), то получим

В результате получим

![]()

![]()

![]()

Последние суммы равны нулю в силу системы двух нормальных уравнений.

Общая сумма квадратов отклонений индивидуальных значений результативного признака у от среднего значения вызвана влиянием множества причин. Условно разделим всю совокупность причин на две группы: изучаемый фактор х и прочие факторы. Если фактор на оказывает никакого влияния на результат, то линия регрессии параллельна оси OX и . Тогда вся дисперсия результативного признака обусловлена воздействием прочих факторов и общая сумма квадратов отклонений совпадет с остаточной. Если же прочие факторы не влияют на результат, то у связана с х функционально и остаточная сумма квадратов равна нулю. В этом случае сумма квадратов отклонений, объяснённая регрессией, совпадает с общей суммой квадратов.

Поскольку не все точки поля корреляции лежат на линии регрессии, то всегда имеет место их разброс как обусловленный влиянием фактора х, т.е. регрессией у по х, так и вызванный действием прочих причин (необъяснённая вариация). Пригодность линии регрессии для прогноза зависит от того, какая часть общей вариации признака у приходится на объяснённую вариацию. Очевидно, что если сумма квадратов отклонений, обусловленная регрессией, будет больше остаточной суммы квадратов, то уравнение регрессии статистически значимо и фактор х оказывает существенное влияние на признак у. Это равносильно тому, что коэффициент детерминации будет приближаться к единице.

Любая сумма квадратов связана с числом степеней свободы (df – degrees of freedom), с числом свободы независимого варьирования признака. Число степеней свободы связано с числом единиц совокупности n и с числом определяемых по ней констант. Применительно к исследуемой проблеме число степеней свободы должно показать, сколько независимых отклонений из n возможных требуется для образования данной суммы квадратов. Так, для общей суммы квадратов требуется (n-1) независимых отклонений, ибо по совокупности из n единиц после расчёта среднего свободно варьируют лишь (n-1) число отклонений. Например, мы имеем ряд значений у: 1,2,3,4,5. Среднее из них равно 3, и тогда n отклонений от среднего составят: -2, -1, 0, 1, 2. Так как , то свободно варьируют лишь четыре отклонения, а пятое отклонение может быть определено, если предыдущие четыре известны.

При расчёте объяснённой или факторной суммы квадратов ![]() используются теоретические (расчётные) значения результативного признака

используются теоретические (расчётные) значения результативного признака

Тогда сумма квадратов отклонений, обусловленных линейной регрессии, равна

Поскольку при заданном объёме наблюдений по x и y факторная сумма квадратов при линейной регрессии зависит только от константы регрессии b, то данная сумма квадратов имеет только одну степень свободы.

Существует равенство между числом степеней свободы общей, факторной и остаточной суммой квадратов отклонений. Число степеней свободы остаточной суммы квадратов при линейной регрессии составляет n-2. Число степеней свободы общей суммы квадратов определяется числом единиц варьируемых признаков, и поскольку мы используем среднюю вычисленную по данным выборки, то теряем одну степень свободы, т.е. df общ. = n–1.

Итак, имеем два равенства:

Разделив каждую сумму квадратов на соответствующее ей число степеней свободы, получим средний квадрат отклонений, или, что то же самое, дисперсию на одну степень свободы D.

;

;

;

;

.

.

Определение дисперсии на одну степень свободы приводит дисперсии к сравнимому виду. Сопоставляя факторную и остаточную дисперсии в расчёте на одну степень свободы, получим величину F-критерия Фишера

где F-критерий для проверки нулевой гипотезы H 0: D факт = D ост.

Если нулевая гипотеза справедлива, то факторная и остаточная дисперсии не отличаются друг от друга. Для H 0 необходимо опровержение, чтобы факторная дисперсия превышала остаточную в несколько раз. Английским статистиком Снедекором разработаны таблицы критических значений F-отношений при различных уровнях существенности нулевой гипотезы и различном числе степеней свободы. Табличное значение F-критерия – это максимальная величина отношения дисперсий, которая может иметь место при случайном их расхождении для данного уровня вероятности наличия нулевой гипотезы. Вычисленное значение F-отношения признаётся достоверным, если оно больше табличного. Если F факт > F табл, то нулевая гипотеза H 0: D факт = D ост об отсутствии связи признаков отклоняется и делается вывод о существенности этой связи.

Если F факт < F табл, то вероятность нулевой гипотезы H 0: D факт = D ост выше заданного уровня (например, 0,05) и она не может быть отклонена без серьёзного риска сделать неправильный вывод о наличии связи. В этом случае уравнение регрессии считается статистически незначимым. Гипотеза H 0 не отклоняется.

В рассматриваемом примере из главы 3:

![]() = 131200 -7*144002 = 30400 – общая сумма квадратов;

= 131200 -7*144002 = 30400 – общая сумма квадратов;

1057,878*(135,43-7*(3,92571) 2) = 28979,8 – факторная сумма квадратов;

![]() =30400-28979,8 = 1420,197 – остаточная сумма квадратов;

=30400-28979,8 = 1420,197 – остаточная сумма квадратов;

D факт = 28979,8;

D ост = 1420,197/(n-2) = 284,0394;

F факт =28979,8/284,0394 = 102,0274;

F a =0,05; 2; 5 =6,61; F a =0,01; 2; 5 = 16,26.

Поскольку F факт > F табл как при 1%-ном, так и при 5%-ном уровне значимости, то можно сделать вывод о значимости уравнения регрессии (связь доказана).

Величина F-критерия связана с коэффициентом детерминации . Факторную сумму квадратов отклонений можно представить как

![]() ,

,

а остаточную сумму квадратов – как

![]() .

.

Тогда значение F-критерия можно выразить как

.

.

Оценка значимости регрессии обычно даётся в виде таблицы дисперсионного анализа

| Источники вариации | Число степеней свободы | Сумма квадратов отклонений | Дисперсия на одну степень свободы | F-отношение | |

| фактическое | Табличное при a=0,05 | ||||

| Общая | |||||

| Объяснённая | 28979,8 | 28979,8 | 102,0274 | 6,61 | |

| Остаточная | 1420,197 | 284,0394 | , его величина сравнивается с табличным значением при определённом уровне значимости α и числе степеней свободы (n-2).

Оценка статистической значимости параметров и уравнения в целом – это обязательная процедура, которая позволяет сделать ввод о возможности использования построенного уравнения связи для принятия управленческих решений и прогнозирования.

Оценка статистической значимости уравнения регрессии осуществляется с использованием F-критерия Фишера, который представляет собой отношение факторной и остаточных дисперсий, рассчитанных на одну степень свободы.

Факторная дисперсия – объясненная часть вариации признака-результата, то есть обусловленная вариацией тех факторов, которые включены в анализ (в уравнение):

где k – число факторов в уравнении регрессии (число степеней свободы факторной дисперсии); - среднее значение зависимой переменной; - теоретическое (рассчитанное по уравнению регрессии) значение зависимой переменной у i – й единицы совокупности.

Остаточная дисперсия – необъясненная часть вариации признака-результата, то есть обусловленная вариацией прочих факторов, не включенных в анализ.

=

=  , (71)

, (71)

где - фактическое значение зависимой переменной у i – й единицы совокупности; n-k-1 – число степеней свободы остаточной дисперсии; n – объем совокупности.

Сумма факторной и остаточной дисперсий, как отмечалось выше, есть общая дисперсия признака-результата.

F-критерия Фишера рассчитывается по следующей формуле:

F-критерий Фишера – величина, отражающая соотношение объясненной и необъясненной дисперсий, позволяет ответить на вопрос: объясняют ли включенные в анализ факторы статистическую значимую часть вариации признака-результата. F-критерий Фишера табулирован (входом в таблицу является число степеней свободы факторной и остаточной дисперсий). Если  , то уравнение регрессии признается статистически значимым и, соответственно, статистически значим коэффициент детерминации. В противном случае, уравнение – статистически не значимо, т.е. не объясняет существенной части вариации признака-результата.

, то уравнение регрессии признается статистически значимым и, соответственно, статистически значим коэффициент детерминации. В противном случае, уравнение – статистически не значимо, т.е. не объясняет существенной части вариации признака-результата.

Оценка статистической значимости параметров уравнения осуществляется на основе t-статистики, которая рассчитывается как отношение модуля параметров уравнения регрессии к их стандартным ошибкам ( ):

):

, где

, где  ; (73)

; (73)

, где

, где  . (74)

. (74)

В любой статистической программе расчет параметров всегда сопровождается расчетом значений их стандартных (среднеквадратических) ошибок и t-статистики. Параметр признаются статистически значимым, если фактическое значение t-статистики больше табличного.

Оценка параметров на основе t-статистики, по существу, является проверкой нулевой гипотезы о равенстве генеральных параметров нулю (H 0: =0; H 0: =0;), то есть о не значимости параметров уравнения регрессии. Уровень значимости принятия нулевых гипотез = 1-0,95=0,05 (0,95 – уровень вероятности, как правило, устанавливаемый в экономических расчетах). Если расчетный уровень значимости меньше 0,05 , то нулевая гипотеза отвергается и принимается альтернативная - о статистической значимости параметра.

Проводя оценку статистической значимости уравнения регрессии и его параметров, мы можем получить различное сочетание результатов.

· Уравнение по F-критерию статистически значимо и все параметры уравнения по t-статистике тоже статистически значимы. Данное уравнение может быть использовано как для принятия управленческих решений (на какие факторы следует воздействовать, чтобы получить желаемый результат), так и для прогнозирования поведения признака-результата при тех или иных значениях факторов.

· По F-критерию уравнение статистически значимо, но незначимы отдельные параметры уравнения. Уравнение может быть использовано для принятия управленческих решений (касающихся тех факторов, по которым получено подтверждение статистической значимости их влияния), но уравнение не может быть использовано для прогнозирования.

· Уравнение по F-критерию статистически незначимо. Уравнение не может быть использовано. Следует продолжить поиск значимых признаков-факторов или аналитической формы связи аргументов и отклика.

Если подтверждена статистическая значимость уравнения и его параметров, то может быть реализован, так называемый, точечный прогноз, т.е. рассчитывается вероятное значение признака-результата (y) при тех или иных значениях факторов (x). Совершенно очевидно, что прогнозное значение зависимой переменной не будет совпадать с фактическим ее значением. Это связано, прежде всего, с самой сутью корреляционной зависимости. Одновременно на результат воздействует множество факторов, из которых только часть может быть учтена в уравнении связи. Кроме того, может быть неверно выбрана форма связи результата и факторов (тип уравнения регрессии). Между фактическими значениями признака-результата и его теоретическими (прогнозными) значениями всегда существует различие ( ). Графически эта ситуация выражается в том, что не все точки поля корреляции лежат на линии регрессии. Лишь при функциональной связи линия регрессии пройдет через все точки поля корреляции. Разность между фактическими и теоретическими значениями результативного признака называют отклонениями или ошибками, или остатками. На основе этих величин и рассчитывается остаточная дисперсия, являющаяся оценкой среднеквадратической ошибки уравнения регрессии. Величина стандартной ошибки используется для расчета доверительных интервалов прогнозного значения признака-результата (Y).

). Графически эта ситуация выражается в том, что не все точки поля корреляции лежат на линии регрессии. Лишь при функциональной связи линия регрессии пройдет через все точки поля корреляции. Разность между фактическими и теоретическими значениями результативного признака называют отклонениями или ошибками, или остатками. На основе этих величин и рассчитывается остаточная дисперсия, являющаяся оценкой среднеквадратической ошибки уравнения регрессии. Величина стандартной ошибки используется для расчета доверительных интервалов прогнозного значения признака-результата (Y).

После того как уравнение регрессии построено и с помощью коэффициента детерминации оценена его точность, остается открытым вопрос за счет чего достигнута эта точность и соответственно можно ли этому уравнению доверять. Дело в том, что уравнение регрессии строилось не по генеральной совокупности, которая неизвестна, а по выборке из нее. Точки из генеральной совокупности попадают в выборку случайным образом, по этому в соответствии с теорией вероятности среди прочих случаев возможен вариант, когда выборка из “широкой” генеральной совокупности окажется “узкой” (рис. 15).

Рис. 15. Возможный вариант попадания точек в выборку из генеральной совокупности.

В этом случае:

а) уравнение регрессии, построенное по выборке, может значительно отличаться от уравнения регрессии для генеральной совокупности, что приведет к ошибкам прогноза;

б) коэффициент детерминации и другие характеристики точности окажутся неоправданно высокими и будут вводить в заблуждение о прогнозных качествах уравнения.

В предельном случае не исключен вариант, когда из генеральной совокупности представляющей собой облако с главной осью параллельной горизонтальной оси (отсутствует связь между переменными) за счет случайного отбора будет получена выборка, главная ось которой окажется наклоненной к оси. Таким образом, попытки прогнозировать очередные значения генеральной совокупности опираясь на данные выборки из нее чреваты не только ошибками в оценке силы и направления связи между зависимой и независимой переменными, но и опасностью найти связь между переменными там, где на самом деле ее нет.

В условиях отсутствия информации обо всех точках генеральной совокупности единственный способ уменьшить ошибки в первом случае заключается в использовании при оценке коэффициентов уравнения регрессии метода, обеспечивающего их несмещенность и эффективность. А вероятность наступления второго случая может быть значительно снижена благодаря тому, что априори известно одно свойство генеральной совокупности с двумя независимыми друг от друга переменными – в ней отсутствует именно эта связь. Достигается это снижение за счет проверки статистической значимости полученного уравнения регрессии.

Один из наиболее часто используемых вариантов проверки заключается в следующем. Для полученного уравнения регрессии определяется -статистика - характеристика точности уравнения регрессии, представляющая собой отношение той части дисперсии зависимой переменной которая объяснена уравнением регрессии к необъясненной (остаточной) части дисперсии. Уравнение для определения -статистики в случае многомерной регрессии имеет вид:

где: - объясненная дисперсия - часть дисперсии зависимой переменной Y которая объяснена уравнением регрессии;

Остаточная дисперсия - часть дисперсии зависимой переменной Y которая не объяснена уравнением регрессии, ее наличие является следствием действия случайной составляющей;

Число точек в выборке;

Число переменных в уравнении регрессии.

Как видно из приведенной формулы, дисперсии определяются как частное от деления соответствующей суммы квадратов на число степеней свободы. Число степеней свободы это минимально необходимое число значений зависимой переменной, которых достаточно для получения искомой характеристики выборки и которые могут свободно варьироваться с учетом того, что для этой выборки известны все другие величины, используемые для расчета искомой характеристики.

Для получения остаточной дисперсии необходимы коэффициенты уравнения регрессии. В случае парной линейной регрессии коэффициентов два, по этому в соответствии с формулой (принимая ) число степеней свободы равно . Имеется в виду, что для определения остаточной дисперсии достаточно знать коэффициенты уравнения регрессии и только значений зависимой переменной из выборки. Оставшиеся два значения могут быть вычислены на основании этих данных, а значит, не являются свободно варьируемыми.

Для вычисления объясненной дисперсии значений зависимой переменной вообще не требуются, так как ее можно вычислить, зная коэффициенты регрессии при независимых переменных и дисперсию независимой переменной. Для того чтобы убедиться в этом, достаточно вспомнить приводившееся ранее выражение ![]() . По этому число степеней свободы для остаточной дисперсии равно числу независимых переменных в уравнении регрессии (для парной линейной регрессии ).

. По этому число степеней свободы для остаточной дисперсии равно числу независимых переменных в уравнении регрессии (для парной линейной регрессии ).

В результате -критерий для уравнения парной линейной регрессии определяется по формуле:

.

.

В теории вероятности доказано, что -критерий уравнения регрессии, полученного для выборки из генеральной совокупности у которой отсутствует связь между зависимой и независимой переменной имеет распределение Фишера, достаточно хорошо изученное. Благодаря этому для любого значения -критерия можно рассчитать вероятность его появления и наоборот, определить то значение -критерия которое он не сможет превысить с заданной вероятностью.

Для осуществления статистической проверки значимости уравнения регрессии формулируется нулевая гипотеза об отсутствии связи между переменными (все коэффициенты при переменных равны нулю) и выбирается уровень значимости .

Уровень значимости – это допустимая вероятность совершить ошибку первого рода – отвергнуть в результате проверки верную нулевую гипотезу. В рассматриваемом случае совершить ошибку первого рода означает признать по выборке наличие связи между переменными в генеральной совокупности, когда на самом деле ее там нет.

Обычно уровень значимости принимается равным 5% или 1%. Чем выше уровень значимости (чем меньше ), тем выше уровень надежности теста, равный , т.е. тем больше шанс избежать ошибки признания по выборке наличия связи у генеральной совокупности на самом деле несвязанных между собой переменных. Но с ростом уровня значимости возрастает опасность совершения ошибки второго рода – отвергнуть верную нулевую гипотезу, т.е. не заметить по выборке имеющуюся на самом деле связь переменных в генеральной совокупности. По этому, в зависимости от того, какая ошибка имеет большие негативные последствия, выбирают тот или иной уровень значимости.

Для выбранного уровня значимости по распределению Фишера определяется табличное значение вероятность превышения, которого в выборке мощностью , полученной из генеральной совокупности без связи между переменными, не превышает уровня значимости. сравнивается с фактическим значением критерия для регрессионного уравнения .

Если выполняется условие , то ошибочное обнаружение связи со значением -критерия равным или большим по выборке из генеральной совокупности с несвязанными между собой переменными будет происходить с вероятностью меньшей чем уровень значимости. В соответствии с правилом “очень редких событий не бывает”, приходим к выводу, что установленная по выборке связь между переменными имеется и в генеральной совокупности, из которой она получена.

Если же оказывается , то уравнение регрессии статистически не значимо. Иными словами существует реальная вероятность того, что по выборке установлена не существующая в реальности связь между переменными. К уравнению, не выдержавшему проверку на статистическую значимость, относятся так же, как и к лекарству с истекшим сроком годнос-

Ти – такие лекарства не обязательно испорчены, но раз нет уверенности в их качестве, то их предпочитают не использовать. Это правило не уберегает от всех ошибок, но позволяет избежать наиболее грубых, что тоже достаточно важно.

Второй вариант проверки, более удобный в случае использования электронных таблиц, это сопоставление вероятности появления полученного значения -критерия с уровнем значимости. Если эта вероятность оказывается ниже уровня значимости , значит уравнение статистически значимо, в противном случае нет.

После того как выполнена проверка статистической значимости регрессионного уравнения в целом полезно, особенно для многомерных зависимостей осуществить проверку на статистическую значимость полученных коэффициентов регрессии. Идеология проверки такая же как и при проверке уравнения в целом но в качестве критерия используется -критерий Стьюдента, определяемый по формулам:

и

и

где: , - значения критерия Стьюдента для коэффициентов и соответственно;

- остаточная дисперсия уравнения регрессии;

- остаточная дисперсия уравнения регрессии;

Число точек в выборке;

Число переменных в выборке, для парной линейной регрессии .

Полученные фактические значения критерия Стьюдента сравниваются с табличными значениями ![]() , полученными из распределения Стьюдента. Если оказывается, что , то соответствующий коэффициент статистически значим, в противном случае нет. Второй вариант проверки статистической значимости коэффициентов – определить вероятность появления критерия Стьюдента и сравнить с уровнем значимости .

, полученными из распределения Стьюдента. Если оказывается, что , то соответствующий коэффициент статистически значим, в противном случае нет. Второй вариант проверки статистической значимости коэффициентов – определить вероятность появления критерия Стьюдента и сравнить с уровнем значимости .

Для переменных, чьи коэффициенты оказались статистически не значимы, велика вероятность того, что их влияние на зависимую переменную в генеральной совокупности вообще отсутствует. По этому или необходимо увеличить число точек в выборке, тогда возможно коэффициент станет статистически значимым и заодно уточнится его значение, или в качестве независимых переменных найти другие, более тесно связанные с зависимой переменной. Точность прогнозирования при этом в обоих случаях возрастет.

В качестве экспрессного метода оценки значимости коэффициентов уравнения регрессии можно применять следующее правило – если критерий Стьюдента больше 3, то такой коэффициент, как правило, оказывается статистически значим. А вообще считается, что для получения статистически значимых уравнений регрессии необходимо, чтобы выполнялось условие .

Стандартная ошибка прогнозирования по полученному уравнению регрессии неизвестного значения при известном оценивают по формуле:

Таким образом прогноз с доверительной вероятностью 68% может быть представлен в виде:

В случае если требуется иная доверительная вероятность , то для уровня значимости необходимо найти критерий Стьюдента и доверительный интервал для прогноза с уровнем надежности будет равен ![]() .

.

Прогнозирование многомерных и нелинейных зависимостей

В случае если прогнозируемая величина зависит от нескольких независимых переменных, то в этом случае имеется многомерная регрессия вида:

где: - коэффициенты регрессии, описывающие влияние переменных на прогнозируемую величину.

Методика определения коэффициентов регрессии не отличается от парной линейной регрессии, особенно при использовании электронной таблицы, так как там применяется одна и та же функция и для парной и для многомерной линейной регрессии. При этом желательно чтобы между независимыми переменными отсутствовали взаимосвязи, т.е. изменение одной переменной не сказывалось на значениях других переменных. Но это требование не является обязательным, важно чтобы между переменными отсутствовали функциональные линейные зависимости. Описанные выше процедуры проверки статистической значимости полученного уравнения регрессии и его отдельных коэффициентов, оценка точности прогнозирования остается такой же как и для случая парной линейной регрессии. В тоже время применение многомерных регрессий вместо парной обычно позволяет при надлежащем выборе переменных существенно повысить точность описания поведения зависимой переменной, а значит и точность прогнозирования.

Кроме этого уравнения многомерной линейной регрессии позволяют описать и нелинейную зависимость прогнозируемой величины от независимых переменных. Процедура приведения нелинейного уравнения к линейному виду называется линеаризацией. В частности если эта зависимость описывается полиномом степени отличной от 1, то, осуществив замену переменных со степенями отличными от единицы на новые переменные в первой степени, получаем задачу многомерной линейной регрессии вместо нелинейной. Так, например если влияние независимой переменной описывается параболой вида

![]()

то замена позволяет преобразовать нелинейную задачу к многомерной линейной вида

![]()

Так же легко могут быть преобразованы нелинейные задачи у которых нелинейность возникает вследствие того, что прогнозируемая величина зависит от произведения независимых переменных. Для учета такого влияния необходимо ввести новую переменную равную этому произведению.

В тех случаях, когда нелинейность описывается более сложными зависимостями, линеаризация возможна за счет преобразования координат. Для этого рассчитываются значения ![]() и строятся графики зависимости исходных точек в различных комбинациях преобразованных переменных. Та комбинация преобразованных координат или преобразованных и не преобразованных координат, в которой зависимость ближе всего к прямой линии подсказывает замену переменных которая приведет к преобразованию нелинейной зависимости к линейному виду. Например, нелинейная зависимость вида

и строятся графики зависимости исходных точек в различных комбинациях преобразованных переменных. Та комбинация преобразованных координат или преобразованных и не преобразованных координат, в которой зависимость ближе всего к прямой линии подсказывает замену переменных которая приведет к преобразованию нелинейной зависимости к линейному виду. Например, нелинейная зависимость вида

превращается в линейную вида

Полученные коэффициенты регрессии для преобразованного уравнения остаются несмещенными и эффективными, но проверка статистической значимости уравнения и коэффициентов невозможна

Проверка обоснованности применения метода наименьших квадратов

Применение метода наименьших квадратов обеспечивает эффективность и несмещенность оценок коэффициентов уравнения регрессии при соблюдении следующих условий (условий Гауса-Маркова):

3. значения не зависят друг от друга

4. значения не зависят от независимых переменных

Наиболее просто можно проверить соблюдение этих условий путем построения графиков остатков в зависимости от , затем от независимой (независимых) переменных. Если точки на этих графиках расположены в коридоре расположенном симметрично оси абсцисс и в расположении точек не просматриваются закономерности, то условия Гауса-Маркова выполнены и возможности повысить точность уравнения регрессии отсутствуют. Если это не так, то существует возможность существенно повысить точность уравнения и для этого необходимо обратиться к специальной литературе.